Hvordan verne om egne data og sikre trygg bruk av AI-verktøy?

Kunstig intelligens har på rekordtid blitt et sentralt verktøy i norske virksomheter, og data er en forutsetning for effektiv bruk. Det å verne om egne data i møte med kunstig intelligens forutsetter bevisste valg. I denne artikkelen skal vi se nærmere på hvem som eier data, hvordan man rettslig beskytter egne data og hvordan man kan implementere og bruke AI-verktøy på en lovlig måte uten at data kommer i feil hender.

Advokatfirmaet Wiersholm

Advokatfirmaet Wiersholm

Partner, Advokatfirmaet Wiersholm

Utviklingen av kunstig intelligens og betydningen av data

Eier man data, eller har man en rett til å bruke data, har man et fortrinn i markedet. Enkelte har derfor omtalt data som den nye oljen.

I november 2022 lanserte teknologigiganten OpenAI språkmodellen ChatGPT, en lansering som på rekordtid endret verdens oppfatning av kunstig intelligens (AI). Nå er AI et «verktøy» alle tar i bruk, og stadig flere virksomheter implementerer ulike AI-verktøy for å effektivisere og forbedre de ansattes arbeidshverdag.

Mange forbinder AI-modeller med ChatGPT, Claude AI, DeepSeek AI eller Gemini AI. Dette er generative AI-modeller – altså AI som skaper innhold som tekst, bilde eller video – og det er disse vi fokuserer på i denne artikkelen. AI-verktøy benytter en eller flere AI-modeller som er trent opp på data, men hvor data også kan benyttes som input i AI-verktøyet. Begrepet kan dermed brukes som en samlebetegnelse på verktøyene som sådan og på de underliggende modellene de består av. Gjennom verktøyet bearbeides input, og det gis en output basert på mønstre AI-verktøyet har lært fra data modellen har tilgjengelig eller er trent på om man vil. Data er derfor helt avgjørende og brukes i alle ledd: til utvikling, trening, testing og ved selve bruken. Verktøyene bygger på analyser av enorme mengder data, og det er kvaliteten, mengden og relevansen av disse dataene som avgjør hvor gode verktøyene blir. Gode datasett gir presise og mer treffsikre resultater, mens dårlige datasett kan føre til feil eller unøyaktigheter.

Med andre ord; uten data ville kunstig intelligens ikke vært mulig. Data er derfor av stor verdi. Eier man data, eller har man en rett til å bruke data, har man et fortrinn i markedet. Enkelte har derfor omtalt data som den nye oljen. Men dersom data er så verdifullt – hvorfor deler vi den så enkelt med AI-verktøyene? For hva skjer egentlig med de dataene du deler, for eksempel e-posten du sender til ChatGPT med spørsmål om AI-en kan forbedre teksten eller oversette den til engelsk?

I denne artikkelen skal vi se nærmere på nettopp dette. Vi skal først avklare hva som egentlig menes med «data», og hvordan man oppnår eierskap til data. Deretter skal vi redegjøre for de juridiske rammene rundt bruken av AI-verktøy, rettighetene til data som du legger inn i AI-verktøyene (input) og rettighetene til data som du får ut av AI-verktøyene (output). Vi skal også forsøke å gi deg noen gode tips på veien til hvordan du kan sørge for tryggere bruk av AI i din virksomhet.

Hva menes med «data»?

Data kan defineres på flere måter. I EUs dataforordning artikkel 2 er data definert som «any digital representation of acts, facts or information and any compilation of such acts, facts or information, including in the form of sound, visual or audio-visual recording». Data kan dermed være alle former for informasjon, herunder rene tall, ord, tekst, bokstavsammensetninger, bilder og videoer, så lenge denne informasjonen manifesterer seg på et medium. For eksempel kan tall i et regneark utgjøre data fordi informasjonen – bestående av tallverdier og tekst – er fysisk representert i et dokument.

Hvem eier data?

Eierskap vs. bruksrett til data

Spørsmålet om hvem som eier data har blitt stadig mer komplekst, særlig i møte med kunstig intelligens og datadrevet virksomhet. Eierskap til data handler i utgangspunktet om retten til å bestemme over dataene: å bruke, kopiere, endre og dele dem, samt å nekte andre å gjøre det samme (eksklusivitet). I praksis gir eierskap mulighet til å verne om dataene og kontrollere videre bruk.

Det er viktig å skille mellom eierskap og det å ha en bruksrett til data. Har man ikke rett til å nekte andre å bruke dataene, eller man kun har en begrenset rett til å bruke dem, har man ikke eierskap, men snarere en bruksrett. I mange tilfeller er det tilstrekkelig med en bruksrett, mens det i andre tilfeller er nødvendig med eierskap ettersom sistnevnte ofte gir større grad av sikkerhet med tanke på andres utnyttelse og den verdien eksklusivitet innebærer.

Hvordan reguleres eierskap og bruksrett til data?

Eierskap gjennom faktisk besittelse

Det klare utgangspunktet for eierskap til data er faktisk besittelse. Den som alene har tilgang til bestemte data, anses i praksis som eier fordi vedkommende kan avgjøre om og hvordan dataene skal deles videre. Dette gjelder for eksempel data man selv har samlet inn eller generert, og har kontroll over. Eierskap til data gjennom besittelse er imidlertid skjørt. Hvis andre får tak i de samme dataene på lovlig vis, har man ikke lenger kontroll over dataene. Dette kan for eksempel være tilfelle dersom dataene deles med et AI-verktøy. Avhengig av hvilket AI-verktøy som benyttes, risikerer man å overføre visse rettigheter til AI-produsenten, f.eks. at dataene kan benyttes som treningsdata og kan tilgjengeliggjøres for andre brukere som output. Faktisk besittelse kan også ha sitt grunnlag i en avtale, og da vil avtalens innhold avgjøre hvilke rettigheter man har.

Eierskap gjennom lovgivning

Selv om det klare utgangspunktet for eierskap til data er faktisk besittelse, vil eierskap også kunne følge av lovgivningen. I motsetning til fysiske objekter finnes det ikke en egen datalov som regulerer eierskap til data. EU har vedtatt dataforordningen (Data Act), som regulerer hvem som kan få tilgang til data, og hvilke betingelser man kan sette for slik tilgang. Formålet med forordningen er å hindre at produsenter av IoT-produkter*Internet of things-produkter, dvs. gjenstander som er koblet til internett og deler data med andre enheter, slik som smarte sensorer, dørlåser, brannalarmer osv. blir sittende som enerådige eiere av data som et produkt skaper. Forordningen regulerer dermed, for alle praktiske formål, bruksrett til data fra IoT-produkter i visse situasjoner.

Når det gjelder eierskap til data brukt i AI-verktøy, finnes det heller ingen spesifikk lovgivning, og den kommende forordningen om kunstig intelligens fra EU (AI Act) tar ikke stilling til eierskapet. Det klare utgangspunktet er likevel at AI kun er et verktøy, slik at de samme reglene som ellers gjelder, også gjelder for AI. Enkelte datatyper eller en samling av data vil derfor kunne være beskyttet under spesifikk lovgivning.

Data som består av et åndsverk eller et fotografisk bilde, kan for eksempel ha vern etter åndsverkloven. Dette forutsetter at det er tale om et åndsverk, altså et litterært eller kunstnerisk verk som er uttrykk for en original og individuell, skapende åndsinnsats, eller et fotografisk bilde, altså et bilde som er tatt ved bruk av kamera eller en annen teknikk tilsvarende bruk av kamera. Opphaveren vil da ha en enerett til kopiering (eksemplarfremstilling) og deling (tilgjengeliggjøring) av dataene for allmennheten, samt en rett til å nekte andre å gjøre det samme.

Tilsvarende gjelder dersom dataene er en del av en database med vern etter åndsverkloven § 24 som beskytter den vesentlige investeringen det innebærer å fremstille en database gjennom innsamling, kontroll eller presentasjon av dataene den inneholder. Databasevernet beskytter ikke de enkelte dataene (datapunktene), men de vesentlige delene av databasen som en helhet. Dette innebærer at f.eks. en stor samling av tall og datapunkter som hver for seg ikke nyter noen beskyttelse, likevel kan være beskyttet som en helhet når de er samlet i en database.

Også forretningshemmelighetsloven oppstiller et vern for data som er å anse som en forretningshemmelighet. Loven omfatter data som ikke er allment kjent eller lett tilgjengelig, og som har kommersiell verdi nettopp fordi de er hemmelige. Innehaveren må også ha truffet rimelige tiltak for å sørge for hemmelighold av dataene. Har dataene lovfestet vern som en forretningshemmelighet, kan ikke tredjeparter urettmessig skaffe seg kunnskap om eller rådighet over dataene, eller urettmessig bruke eller formidle dataene. Dersom innehaver av forretningshemmeligheten velger å offentliggjøre dataene, vil det lovfestede vernet opphøre. Dette kan for eksempel være tilfellet dersom dataene legges inn i et AI-verktøy, avhengig av hvordan vilkårene fra leverandør av AI-verktøyet er utformet.

Eierskap gjennom avtaler

Et annet grunnlag for eierskap til data er avtaler. Selv om eierskap til data kan følge av både besittelse og lovregulering, vil parter også kunne inngå avtaler som regulerer eierskap eller bruksrett til data. Slike avtaler vil, avhengig av hvordan de er utformet, ha forrang for eventuell lovgivning og besittelse. Ettersom det ikke er noen klar bakgrunnsrett å falle tilbake på, bør avtalen gjenspeile alle rettighetene man ønsker å ha, og inneholde gode og presise reguleringer. Benytter man AI-verktøy, bør man også være oppmerksom på at vilkårene man underlegges, kan inneholde avvik fra øvrig lovgivning, slik at man ender opp med å gi fra seg bruksrett eller fullt eierskap til egne data som man legger inn i AI-verktøyet.

Bør man begrense deling av data med AI-verktøy?

Bruken av store datamengder er kjernen i utviklingen av AI-verktøy. Ved å analysere og lære av omfattende datasett kan verktøyene gjenkjenne mønstre, fatte beslutninger og skape innhold av høy kvalitet. Samtidig reiser denne teknologien viktige spørsmål om hvorvidt det bør settes grenser for hvilke og hvor mye data som deles med AI-verktøy.

Som omtalt over, skiller man mellom eierskap og bruksrett til data. Dersom man er eier av data, er det klare utgangspunktet at dataene kan deles med tredjeparter. Dette gjelder uavhengig av om dataene deles med fysiske personer eller med et AI-verktøy. Deles data med tredjeparter, risikerer man likevel å miste kontrollen over dataene, og dermed også eierskapet. Bakgrunnen for dette er at AI-verktøy, avhengig av hvordan vilkårene er utformet, vil kunne tilegne seg rettighetene til input, f.eks. for opptreningsformål. For eksempel følger det av OpenAI sine vilkår for ChatGPT at brukeren beholder eiendomsrett til både input og output, men at OpenAI kan:

«bruke innholdet ditt over hele verden for å levere, vedlikeholde, utvikle og forbedre tjenestene våre, overholde gjeldende lover, håndheve våre vilkår og retningslinjer og holde tjenestene våre trygge.»

OpenAI kan med andre ord bruke dataene du legger inn i AI-verktøyet som treningsdata. Med dette gir man fra seg eierskapet og kontrollen over dataene. Man bør derfor ha et bevisst forhold til hvilke data man deler med hvilke AI-verktøy. Dette gjelder enten man deler dataene via en «prompt» (tekstinstruks) eller komplette filer.

Dersom man kun har en bruksrett til data, må man utvise særlig varsomhet. Mange virksomheter har for eksempel kun rett til å bruke kunders data for å utføre bestemte tjenester. Som revisor har man gjerne inngått en avtale med kunden om bruk av kundens tallgrunnlag for å sette opp kvartalsrapporter eller gjennomføre revisjon. Slike avtaler inneholder gjerne konfidensialitetsklausuler som pålegger revisor en forpliktelse til blant annet å holde tallmateriale konfidensielt. Avhengig av hvordan avtalen er formulert, vil det for slike tilfeller kunne foreligge et brudd på avtalen dersom revisor for eksempel deler tallmaterialet inn i åpne AI-verktøy, dvs. AI-verktøy som forbeholder seg retten til å bruke input for andre formål.

Dersom det ikke er inngått noen avtale med kunden, vil begrensninger kunne følge av lovgivningen. For revisorer inneholder for eksempel revisorloven § 10-1 en plikt for revisor til å «hindre at uvedkommende får adgang eller kjennskap til opplysninger som mottas i forbindelse med foretakets virksomhet, med mindre revisor i eller i medhold av lov er gitt plikt eller adgang til å gi taushetsbelagte opplysninger». Revisor er følgelig underlagt en generell taushetsplikt. Denne kan kun fravikes dersom ett av unntakene i § 10-1 (2) er oppfylt, for eksempel dersom revisor har innhentet samtykke fra kunden. Ukritisk deling av data med åpne AI-verktøy vil dermed kunne være i strid med revisorlovens taushetsbestemmelser.

Skal man dele data man ønsker å verne om med AI-verktøy, er det derfor viktig å benytte en lukket AI-løsning som i henhold til vilkårene ikke kan benytte input for andre formål enn å levere tjenesten, for eksempel AI-løsninger som man installerer på egen server.

Hvem eier svarene til AI-verktøyene, og hvordan kan disse brukes?

Flere AI-verktøy baserer output på tidligere erfaringer. Når AI-verktøyet får en instruks, benytter den erfaring til å forutsi det svaret som mest sannsynlig bør komme, basert på instruksjonen fra brukeren og treningsdataene AI-verktøyet er trent på. Hvis AI-verktøyet får spørsmålet «hva er hovedstaden i Frankrike», vil verktøyene analysere spørsmålet og søke etter mønster i treningsdataene som ligner på denne typen spørsmål. Verktøyet vil så finne ut at det sannsynlige svaret er Paris, da dette oftest følger etter slike spørsmål i tekst den har sett. Tilsvarende vil verktøy som er trent opp til å ha generell kunnskap om revisjonsfaget, basere svaret sitt på hva den har erfart at er relevante og riktige svar på lignende spørsmål i treningsmaterialet.

Utgangspunktet er at data brukeren får ut av AI-verktøyet, kan brukes fritt, med mindre brukervilkårene sier noe annet. Dersom AI-verktøyet er trent på data som er beskyttet av opphavsretten, risikerer man imidlertid at verktøyet produserer output som helt eller delvis består av opphavsrettslig beskyttede data. Bruk av slikt materiale vil følgelig kunne være i strid med åndsverkloven, enten det er kopiering for bruk internt eller videredeling til andre, uten samtykke fra opphaveren. I praksis er det imidlertid vanskelig å foreta slike vurderinger fra gang til gang, men det er en problemstilling man uansett bør være bevisst på, og forsøke å unngå gjennom instruksene som gis til AI-verktøyet.

Også andre immaterialrettslover som varemerkeloven, designloven, markedsføringsloven og patentloven kan krenkes dersom brukeren anvender output på en måte som er i strid med andres rettigheter. For eksempel kan output være en etterligning i strid med etterligningsvernet i markedsføringsloven §§ 25 og 30 eller en krenkelse av andres varemerkerettigheter etter varemerkeloven. Bruker man AI-verktøyet til å generere forslag til logoer til bruk i varemerker, er det for eksempel viktig at man gjør egne undersøkelser før man tar i bruk varemerket, for å sørge for at bruken ikke krenker andres rettigheter.

Hvordan verne om egne og kunders data når AI brukes?

Selv om bruken av AI-verktøy kan gi betydelige effektiviseringsgevinster, innebærer det også en risiko knyttet til både eierskap, konfidensialitet og sikkerhet for egne og andres data. Disse utfordringene innebærer ikke at man ikke skal ta i bruk AI-verktøy, men at man bør ha en kritisk tilnærming både til verktøyene man benytter, og til måten data behandles på, og man bør ta enkelte forholdsregler for å sikre godt vern av data når AI benyttes – enten det gjelder egne forretningsdata eller informasjon virksomheten forvalter på vegne av kunder.

Sentralt for vurderingen står vilkårene som regulerer bruken av AI-verktøyet, samt hvilke sikkerhetsmekanismer AI-verktøyet bygger på. For eksempel bør man lese grundig gjennom vilkårene til AI-verktøyet og sørge for at man forstår disse før man legger inn data i AI-verktøyene. Dette er særlig viktig dersom man benytter seg av data som ikke skal deles med tredjeparter.

Ønsker man å bruke AI-verktøy til deling av data som skal holdes konfidensielt, bør man ta i bruk en lukket AI-løsning. Slike løsninger tilbys gjerne som egne betalingsløsninger eller bedriftsløsninger. Alternativt kan man også lokalt konfigurere eller installere AI-verktøyet på servere virksomheten selv kontrollerer, slik at dataene aldri forlater virksomhetens systemer.

En annen sentral faktor ved valg av AI-verktøy er sikkerhet. Dette kan sikres både ved å velge en leverandør som tar sikkerhet på alvor, og som forplikter seg til konkrete sikkerhetstiltak i vilkårene sine. For eksempel har AI Act, som foreløpig ikke er gjennomført i Norge, til formål å sikre at AI-systemer oppfyller grunnleggende rettigheter og sikkerhet, bl.a. gjennom krav til tilstrekkelig cybersikkerhet for AI-verktøyet.

Leverandører i EU/EØS, som dermed er fullstendig underlagt europeisk lovgivning, vil oftere være et tryggere valg enn aktører som er underlagt lovgivning andre steder i verden. Selv om de europeiske rettsreglene som AI Act og GDPR i utgangspunktet alltid vil gjelde når det leveres tjenester til europeiske virksomheter, vil likevel øvrig lovgivning i andre jurisdiksjoner kunne svekke sikkerheten og øke risikoen for at data kan komme på avveie. Dette gjelder særlig risikoen for utlevering av data til myndighetsaktører.

Alternativt, for å sikre full kontroll, kan man som virksomhet sette opp AI-verktøyet på en server som kontrolleres av virksomheten i Norge eller EØS, og sikre at det ikke overføres opplysninger til andre enn virksomheten selv. Dette vil i utgangspunktet kunne minimere risikoen for at data kommer på avveie. Samtidig stiller dette store krav til virksomhetens evne til å implementere sikkerhetstiltak og vedlikeholde løsningen.

Det anbefales også å etablere interne retningslinjer for ansattes bruk av AI for å sikre trygg bruk, samt minimere risikoen for at data kommer på avveie, og at AI brukes i strid med immaterialrettslovgivningen. Formålet med retningslinjene er altså å sørge for at ansatte blir bevisstgjort på risikoen rundt bruk av AI. Retningslinjene må tilpasses den spesifikke virksomheten, men kan for eksempel inneholde nøkkelprinsipper for bruk av AI, herunder at ansatte alltid skal ha et bevisst forhold til hvilke data som deles med AI-verktøyene, sørge for å overholde kundeavtaler, hindre deling av virksomhetssensitiv data og at alt AI-produsert innhold skal gjennomgås av en fysisk ansatt for kvalitetssikring før ekstern publisering. Man burde i slike retningslinjer også klargjøre hvilke konkrete verktøy de ansatte har lov til å ta i bruk, og hvilke verktøy de ansatte ikke kan benytte. Etter AI Act skal også leverandører og idriftsettere av AI-systemer treffe tiltak for å sikre AI-kompetanse hos sine ansatte, slik at virksomheter bør vurdere å innta informasjon om AI som en del av sitt opplæringsmateriale.

Hva bør du huske på for tryggere bruk av AI-verktøy?

Oppsummert er det enkelte risikofaktorer knyttet til eierskap av data og sikkerhet ved bruk av AI-verktøy. Disse risikoene kan likevel begrenses ved å ha et bevisst forhold til hvilke AI-verktøy som tas i bruk, og de gjeldende vilkårene.

For å hjelpe deg på veien har vi utarbeidet en ikke-uttømmende huskeliste:

Les og forstå brukervilkårene før du tar i bruk et AI-verktøy. Dersom AI-verktøyet får rettigheter til data, enten eierskap eller bruksrett, bør du være kritisk til hvilke data du velger å dele, og gjerne anonymisere dataene før bruk.

Sørg for at bruk av kunders data er i overenstemmelse med kundeavtalen. Del aldri kunders data med en åpen AI-løsning med mindre kunden samtykker.

Velg AI-verktøy som overholder krav til datasikkerhet, gjerne egne bedriftsløsninger eller lokale installasjoner, ved behandling av data som må holdes konfidensielt.

Utarbeid interne retningslinjer for bruk av AI og sørg for at ansatte får nødvendig opplæring.

Utarbeid en liste over konkrete AI-verktøy som de ansatte kan benytte, og gjør jevnlig revisjoner av disse i samsvar med virksomhetens interne retningslinjer.

Gjennomgå og vær kritisk til bruken av AI-generert innhold i kundeleveranser og innhold som publiseres offentlig.

Sørg for å holde deg oppdatert på nye regler for bruk av AI og tilpass bruken til endrede krav.

For eksempel kan du abonnere på Wiersholms nyhetsbrev som kvartalsvis gir deg siste nytt om juridiske krav til data og AI.

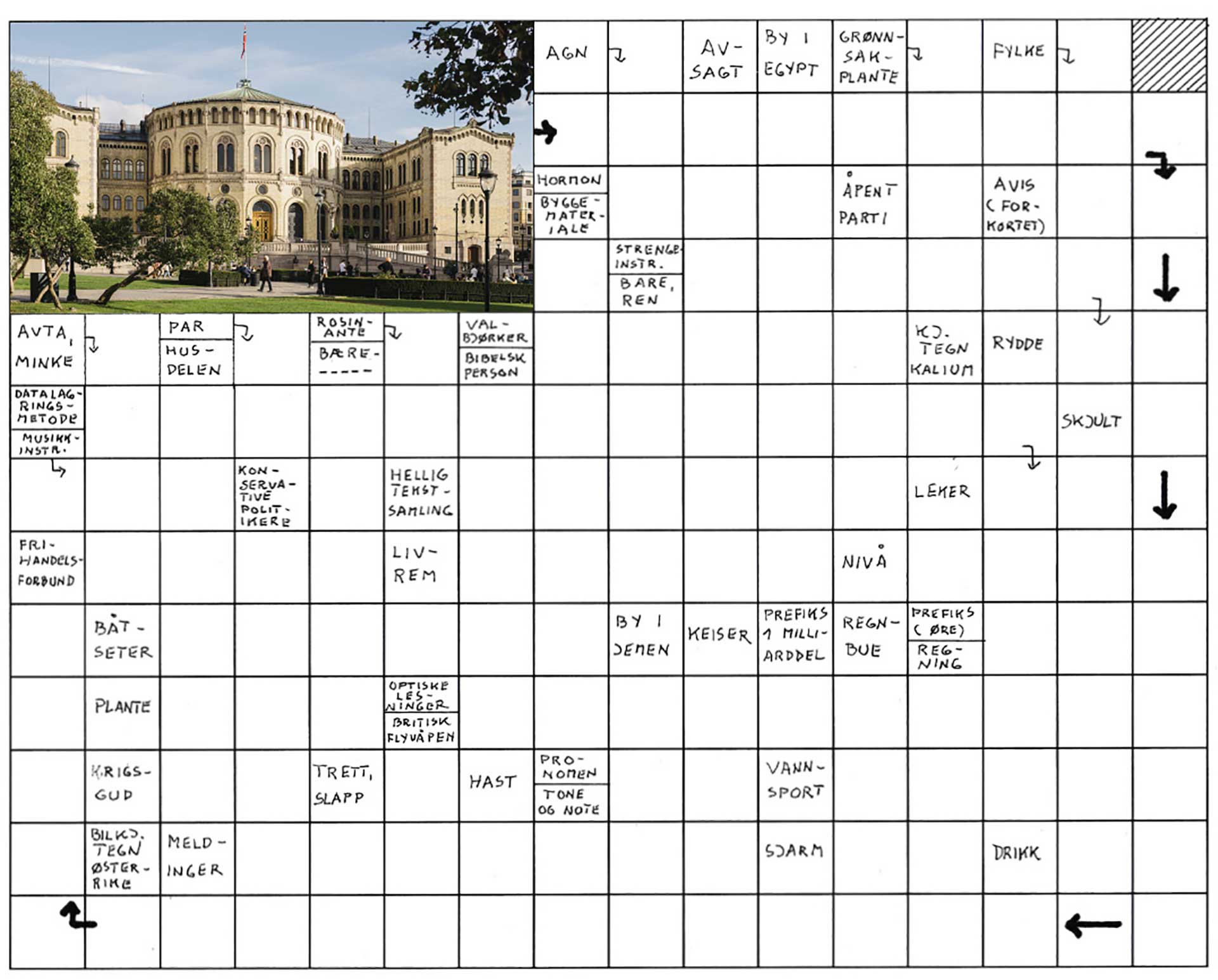

Svar på kryssordet finner du på side 37

Kryssordforfatter: Rolf Bangseid

Foto: Bow