En ny «AI-sommer» for ekspertregler?

Selskaper som OpenAI og NVIDIA har opplevd en enorm verdiøkning drevet av markedets forventninger om store produktivitetsgevinster fra Generativ AI. Til tross for dette har vi ikke sett effekter på makronivå som AI-entusiaster håper på, og AI-pessimister frykter – produktivitet har ikke skutt i været, få jobber har forsvunnet.

Chief Technical Officer, 24SevenOffice

Product Manager, 24SevenOffice

I denne artikkelen drøfter vi hvordan årsaken kan være en undervurdering av hvor mange oppgaver i forskjellige bransjer som er komplekse, og har lav toleranse for feil. Basert på våre erfaringer med automatisering i regnskap og revisjon foreslår vi en kombinasjon av moderne AI-teknologi og klassiske ekspertregler for trygg og gjennomsiktig bruk av AI i regnskap og revisjon.

Hvor ble det av produktivitetsgevinsten?

OpenAIs lansering av ChatGPT høsten 2022 ble startskuddet for en ny bølge av begeistring for – og investering i – generativ kunstig intelligens (GenAI)*«Generativ» er egentlig et dårlig navn på AI-teknologien bak ChatGPT – det er slett ikke noe nytt og unikt at AI-modeller kan generere nye svar som ikke finnes i maskinlæringsmodellenes treningsdata. Det nye handler om at modeller som GPT er mer allsidige og kan brukes på et bredere spekter av anvendelser «ut av boksen» uten skreddersøm. EUs AI-forordning bruker begrepet «general purpose», som treffer bedre, og som heldigvis fremdeles kan forkortes til «GenAI».. Ikke bare ble ChatGPT tidenes raskest voksende app*ChatGPT nådde 100 millioner aktive brukere kun to måneder etter lansering, sml. ni måneder for TikTok og 30 måneder for Instagram. Senere ble rekorden slått av Threads, som riktignok fikk mye drahjelp fra tett integrasjon med nettopp Instagram., markedsverdien av OpenAI og andre selskap tett knyttet til GenAI-bølgen har siden den gang mangedoblet seg i verdi. Markedsverdien av AI-hardware-produsenten NVIDIA har siden den gang gått åtte-gangeren, og nå kniver NIVIDIA med Apple og Microsoft om å være verdens mest verdifulle selskap på papiret.

Prisingen av OpenAI, NVIDIA og andre «AI-nære» selskap tilsier at markedet forventer store produktivitetsgevinster fra – og betalingsvilje for – AI-løsninger i tiden som kommer. I enkelte bransjer, som programmering og journalistikk, har da også bruk av AI-støtteverktøy blitt den nye normalen, og i en ofte sitert artikkel*Dell’Acqua, Fabrizio, Edward McFowland III, Ethan Mollick, Hila Lifshitz-Assaf, Katherine C. Kellogg, Saran Rajendran, Lisa Krayer, François Candelon, and Karim R. Lakhani. «Navigating the Jagged Technological Frontier: Field Experimental Evidence of the Effects of AI on Knowledge Worker Productivity and Quality.» Harvard Business School Working Paper, No. 24-013, September 2023. fra september 2023 estimerte forskere ved Harvard tosifret prosent gevinst i både effektivitet og kvalitet når de sammenlignet BCG-konsulenter som jobbet med og uten støtte av AI.

Samtidig uteblir de store AI-produktivitetsresultatene på makronivå. I USA rapporterer fremdeles kun 5–6 % av selskapene at de bruker AI direkte i produksjonen av varer og tjenester, og enn så lenge er det vanskelig å se noe utslag av AI-teknologi på vekst i BNP (eller for den saks skyld i økt arbeidsledighet når «AI tar jobbene våre».)* https://www.economist.com/the-world-ahead/2024/11/20/there-will-be-no-immediate-productivity-boost-from-ai

Et mindre omtalt funn fra Harvard-studien var at de spektakulære produktivitetsresultatene kun gjaldt oppgaver «within the frontier of AI capabilities». For en oppgave «outside the frontier» gjorde studiens AI-brukere tvert imot flere feil enn kontrollgruppen som jobbet på gamlemåten, uten tilgang på AI. Studien definerte «within the frontier» som relativt spisst formulerte, konkrete oppgaver, som «skriv 10 ideer for nye sko-modeller til brukergrupper/sporter der markedet ikke er mettet», eller «foreslå tre måter en kan teste om et markedsføringsbudskap vil slå an». På studietidspunktet, da GPT-4 var state-of-the-art, ble oppgaven «se over et regneark med finansielle tall og intervju-transkripsjoner fra sentrale stakeholdere, og skriv et notat med anbefalinger til adm.dir.» ansett som «outside the frontier».

Kan den uteblivende generelle AI-produktivitetsgevinsten skyldes at de største AI-entusiastene (og markedet) har undervurdert hvor mange oppgaver ute i næringslivets mangslungne verdikjeder som er utenfor den nye generasjonen AI-modellers kapabiliteter?

Flyvedlikehold, hjernekirurgi, revisjon og regnskap

Det kan være forskjellige grunner til at en oppgave ligger «outside the frontier» for AI-anvendelser. To typiske årsaker er:

Type 1: Oppgaven er kompleks og vanskelig å dele opp i mindre, mer håndterbare deler (f.eks. å lese «mellom linjene» i kreativt utformede regneark og hva som blir sagt og usagt i intervjuer)

Type 2: Oppgaven har høy konsekvens av – og lav toleranse for – unøyaktigheter og feil (f.eks. finne frem til og anvende spesifikke Høyesterettsdommer i en rettssak der mye står på spill)

Ikke minst har mange bransjer oppgaver som er både komplekse, og har lite rom for feil, og hvor det foreligger detaljerte regulatoriske føringer for hvordan ting skal gjøres. Vedlikehold av fly. Hjernekirurgi. Og ikke minst: Regnskap.

Regnskap og revisjon treffes av både type 1 og type 2-utfordringer når AI skal anvendes. Som gjennomregulerte bransjer med organisasjoner optimalisert for nåværende prosesser er det ofte kostbart å endre hvordan oppgaver utføres – utvikling og anvendelse av AI må ofte skje innenfor rammene av prosesser og regulatoriske føringer utformet for mennesker, ikke maskiner*En av forfatterne har skrevet om dette tidligere i Revisjon og Regnskap nr. 3-2022 https://www.revregn.no/journal/2022/3/m-1292/Automatisering_av_revisjon/.

I tillegg må vurderinger og handlinger kunne etterprøves. Det er ikke alltid menneskelige vurderinger er spesielt gjennomsiktige, men mennesker kan formulere begrunnelser der det er påkrevd, eller i alle fall stilles til veggs i etterkant hvis noe går galt – «hvorfor tenkte du slik?» Med GPT og andre moderne maskinlæringsmodeller er man prisgitt de innblikk eierne gir i den underliggende beslutningslogikken, og det er ofte svært lite. Selv der modellenes arkitektur og parameterverdier deles åpent, er kompleksiteten så stor at det er vanskelig for menigmann å få noe ut av informasjonen. GenAI-verktøy er i stor grad svarte bokser, der forespørsler kommer inn og svar kommer ut, med lite informasjon om hva som foregår under panseret.

Da vi jobbet i revisjonshuset PwC i 2019, var prognosen at alle repeterende oppgaver i regnskap og revisjon snart ville automatiseres. Vi snakket allerede den gang om hvordan vi – etter å ha kvittet oss med tidkrevende og rutinepregede oppgaver – endelig skulle vie mesteparten av tiden til å være «trusted business advisor» for kundene! I dag, seks år senere, har vi kommet et stykke på vei: teknologiske løsninger blir stadig mer sofistikerte, og flere av de oppgavene ferske revisorer og regnskapsførere brukte lange timer på i 2019, er nå i stor grad automatisert. Likevel er vi fortsatt langt unna den totale omstillingen vi den gang så for oss.

Det som var AI i går, er tradisjonell software i dag

Begeistring og skuffelse har gått hånd i hånd opp gjennom AI-utviklingens historie. Optimistisk «AI-sommer» med store lovnader og investeringer blir fulgt av skuffet «AI-vinter» når siste skrik av AI-teknologi har vist sine begrensninger. I 1966 kunne «AI-terapeuten» ELIZA*https://psych.fullerton.edu/mbirnbaum/psych101/eliza.htm gi inntrykk av at menneskelignende chatboter var rett rundt hjørnet – dersom noe så avansert som psykoterapi var «within the AI frontier», måtte da generelle AI-rådgivere være rett rundt hjørnet?

Men ELIZAs profesjon var ikke tilfeldig valgt: Rogeriansk psykoterapi legger vekt på å ta utgangspunkt i samtalepartnerens egne opplevelser og speile disse tilbake gjennom åpne spørsmål. Dermed kunne ELIZAs svar konstrueres ved hjelp av en samling forhåndsdefinerte ekspertregler som

(YOU * ME) → (WHAT MAKES YOU THINK I * YOU?)

“You don’t listen to me” → WHAT MAKES YOU THINK I DON’T LISTEN TO YOU?

Eksempel på ekspertregel fra ELIZA.

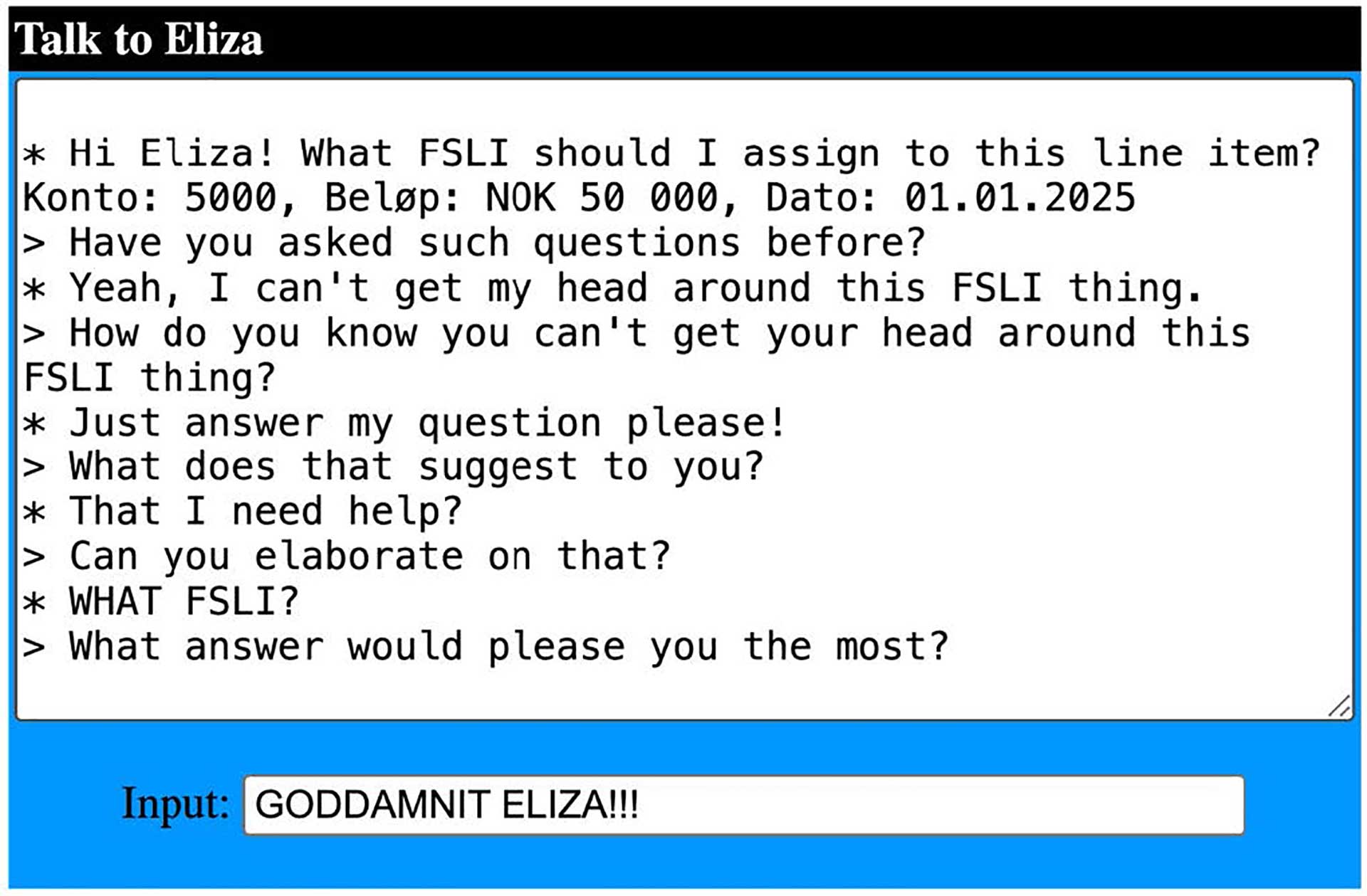

For en kjapp coaching-samtale med ELIZA var dette ofte tilstrekkelig til å gi inntrykket av intelligens, og kanskje gi en slags verdi til samtalepartneren? For en nyansatt revisor stilt overfor et faglig spørsmål, ville det imidlertid neppe være mye hjelp å hente fra ELIZAs «Hva føler du selv»-tilnærming til alle innkommende spørsmål, jf. figur 1 nedenfor.

Figur 1: Ekspertregelbasert AI fra 1966 var ikke helt klar for regnskapsteknisk rådgivning.

På 70-tallet var tålmodigheten over. Ekspertregel-systemer vokste seg uoversiktlig store og ble raskt utdatert når komplekse og dynamiske oppgaver skulle automatiseres. Eksperimentelle nevralnett-modeller krevde tilgang på mengder data og regnekraft som (den gang) var ren science fiction. Drømmen om at menneskelignende intelligente maskiner var rett rundt hjørnet brast. Den første AI-vinteren var et faktum.

Siden den tid har teknologiske gjennombrudd hos NVIDIA og andre hardwareprodusenter gitt oss rikelig med regnekraft, og internett har gitt oss enorme mengder treningsdata. I dag er det enormt regnekraft- og datakrevende nevralnett-basert maskinlæring som stikker av med de store AI-overskriftene, mens automatisering med (menneskeskapte) ekspertregler ikke en gang omfattes av AI-definisjonen i EUs AI-forordning: «[the definition] should not cover systems that are based on the rules defined solely by natural persons to automatically execute operations» (preamble 12). Systemer som ble ansett som cutting edge AI på 60-tallet, ville flydd under AI Act-radaren som tradisjonell software i dag.

At ekspertregler ikke lenger anses som AI, betyr ikke at de ikke er viktige – det står fremdeles ekspertregler bak et overveldende flertall av automatiserte prosesser i privat- og næringslivet. De fleste digitale produkter har ekspertregelmotorer som en mer eller mindre integrert del av funksjonaliteten – fra e-postklienter som lar deg definere regler for hvilke mapper forskjellige e-poster skal sorteres i, til smarthus med regelstyring av lys og oppvarming basert på tidspunkt og strømpriser. Ikke minst handler mye av verdiforslaget til Robotic Process Automation (RPA)-softwareindustrien om å muliggjøre avansert ekspertregelbruk i systemer som ikke har mulighet for dette innebygget.

Det er ikke tilfeldig at ekspertregler har holdt stand som en eviggrønn automatiseringsteknologi i mer enn seksti år. De er enkle å gjøre etterprøvbare med logging, og de er transparente – så lenge reglene ikke blir for mange og/eller komplekse, kan menneskelige eksperter føre tilsyn med reglene og til enhver tid vurdere om beslutningsmønstrene reglene i sum legger opp til, holder vann forretningsmessig og regulatorisk. Slik er ekspertregler sterke på de områdene der GenAI kommer til kort. Det kan vise seg at nettopp ekspertregler – som en gang ble ansett som et feilspor i jakten på menneskelignende maskinintelligens – kan være løsningen for å muliggjøre bruk av black-box AI i komplekse høyrisikoprosesser, inkludert regnskap og revisjon.

Bilagsflyt i en høypresisjonsverden

Bilagsbehandling og bokføring – altså prosessen fra faktura mottas til den er korrekt bokført – er et godt eksempel på regnskapsaktiviteter med stort potensial for å hente ut gevinster gjennom AI og automatisering. Prosessen er ofte preget av repeterende steg som kontering, godkjenning og betaling, noe som i utgangspunktet taler for et høyt potensial for automatisering og AI-støttet kontering, men når rutinearbeid skal kombineres med nulltoleranse for feil og type-2 forventninger, må automatisering støttes opp av tydelige rammer. Moderne AI-løsningers manglende transparens og begrensede etterprøvbarhet begrenser verdi og adopsjon i regnskap – der presisjon og kontroll er avgjørende.

I en fremsynt artikkel tilbake i 2020 drøftet Ellefsen «forklarbar kunstig intelligens» (XAI, fra «eXplainable Artificial Intelligence») som en forutsetning for adopsjon for automatiseringen av bokføringsoppgaver* https://www.regnskapnorge.no/aget/artikler/teknologi2/forklarbar-kunstig-intelligens-gir-tillit/. De siste årene har XAI vært et aktivt forskningsfelt der blant andre vår tidligere kollega Inga Strümke har gitt viktige bidrag*https://arxiv.org/abs/2102.10936. Det finnes lovende tilnærminger for å gjøre AI-modeller mer gjennomsiktige, men det meste er fremdeles på forskningsstadiet, spesielt for GenAI. Spørsmålet blir hvordan kan vi høste gevinster av automatisering med (potensielt) black-box AI, uten å undergrave regnskapsprosessens krav om pålitelighet og korrekthet?

Automatisering med ekspertregler

Vi tror nøkkelen til trygg bruk av AI går gjennom ekspertregler, og i 24SevenOffice investerer vi nå tungt i regnskapssystemets innebygde ekspertregelmotorer. Først ut er automatisert bilagsflyt: Ved hjelp av konkrete, forhåndsdefinerte instruksjoner kan regnskapsførere definere opp regler som

“Hvis leverandør X sender en faktura under 10 000 kroner, bokfør automatisk på kostnadskonto Y, med gitte dimensjoner og avdelinger.”

“Hvis faktura med egenskap X fra selskap Y må alltid daglig leder godkjenne”

Dette gir en forutsigbar automatisering i en type-2 prosess der selv små feil kan få store konsekvenser.

Interne estimater tyder på at slike regnskapsførerskapte og -vedlikeholdte ekspertregler i den utvidede ekspertregelmotoren alene vil være dekkende for rundt 70 % av det identifiserte automatiseringspotensialet i bilagsflyten.

Automatisering med AI-genererte ekspertregler

Neste steg, som nå er under utvikling, er å la AI foreslå slike ekspertregler på egen hånd. Maskinlæring, basert på historiske data og konteringspraksis, kan oppdage mønstre og gi stadig mer treffsikre anbefalinger. Over tid vil systemet kunne foreslå at «leverandør X burde alltid konteres som Y» innenfor etablerte rammer av regler satt av regnskapsførere. Her fungerer AI som en assistent, og alle forslag må valideres av en regnskapsfører før de implementeres. Regnskapsføreren tar ansvar for sluttresultatet og sikrer at black-box AI ikke overskrider etablerte retningslinjer eller bransjestandarder, samtidig som AI-en kan foreslå komplekse regler basert på trender som brukeren kanskje selv ikke var klar over, og gjennom overvåkning og prioriteringsforslag muliggjøre bruk av større antall enkeltregler som ellers – i sum – har for høye vedlikeholdskostnader.

AI-genererte ekspertregler fungerer som en enkel form for XAI: Ved å tvinge AI-anbefalingene inn i ekspertregel-format får vi en forenklet «oversettelse» som gir etterprøvbart innblikk i tankerekken bak hver kontering, slik at andre interessenter – som revisoren og økonomilederen – kan forstå rasjonalet fra bokføring tilbake til regelimplementering. Ikke bare kan regnskapsføreren raskt avgjøre om den nye regelen bør godkjennes – revisoren kan i neste omgang se hvem som godkjente regelen, hvilke rutiner som ble fulgt, og om dette samsvarer med lover og bransjekrav. Samtidig får CFO-en en tydelig oversikt over hvilke områder som automatiseres, hvilke risikomomenter som finnes, og hvordan automatiseringsreglene bidrar til økt effektivitet. AI kombinert med ekspertregler gir en sammenhengende og gjennomsiktig «chain of thought» som alle involverte kan etterprøve og stole på.

Automatisering med AI-forsterkede ekspertregler

En kan også angripe black-box-problemstilingen fra motsatt side: Menneskelige eksperter kan først definere ytre rammer for hva en vil tillate AI å gjøre, og så la (potensielt blackbox) AI handle autonomt innenfor disse rammene. Et eksempel:

Når en ny leverandørregistrering gjøres i regnskapssystemet, sendes data først til en (black-box) AI som vurderer sanksjonsrisiko. Hvis den AI-genererte risikoscoren overstiger en tekskelverdi, settes leverandøren på manuell kontroll før den kan opprettes i leverandørregisteret.

I dette eksempelet etterprøves ikke AI-beslutningen (risikoscoren) direkte av mennesker før prosessen går videre, men konsekvensene av AI-ens vurderinger er begrenset til hvorvidt en gitt leverandør settes til manuell kontroll eller ikke: Gjennomsiktigheten i hvorfor den AI-genererte risikoscoren ble det den ble, er altså ikke økt, men en har full kontroll over rammene og konsekvensene av eventuelle feilbeslutninger den begrensede gjennomsiktigheten kan forårsake. Ved å åpne for at regnskapsfører-konfigurerte ekspertregler benytter internutviklede AI-systemer, tar man vare på mye av effektiviteten og presisjonen som black-box-løsninger kan levere, samtidig som potensielle konsekvenser av AI-beslutningene er transparente og dokumenterbare.

There and Back Again

Ved å kombinere AI med ekspertregler får man en løsning som både er tilpasset kravene til presisjon i regnskap, og som muliggjør innsikt i hver enkelt beslutning. Ved å ramme AI-anvendelser inn i robuste ekspertregelmotorer unngår man problemstillingene knyttet til «svarte bokser» som automatisk konterer fakturaer. Til tross for enorme fremskritt i maskinlæring og datakraft, kan den gamle ideen om ekspertregler paradoksalt nok bli bærebjelken for trygg og gjennomsiktig anvendelse av fremtidens AI-løsninger i komplekse og risikofylte prosesser. «Plus ça change, plus c’est la même chose»: ELIZA hadde vært stolt.

.gif)