Føderert maskinlæring og kommersialisering av lovpålagte plikter

For de fleste aktører er arbeid med etterlevelse av lovpålagte plikter og andre regelverk først og fremst forbundet med kostnader, men etter hvert som etterlevelses-prosesser blir mer datadrevet, oppstår det muligheter for å gjøre arbeid med lovpålagte plikter om til nye kommersielle produkter og tjenester, gjennom bygging og bruk av matematiske beslutningsmodeller med maskinlæring (ML).

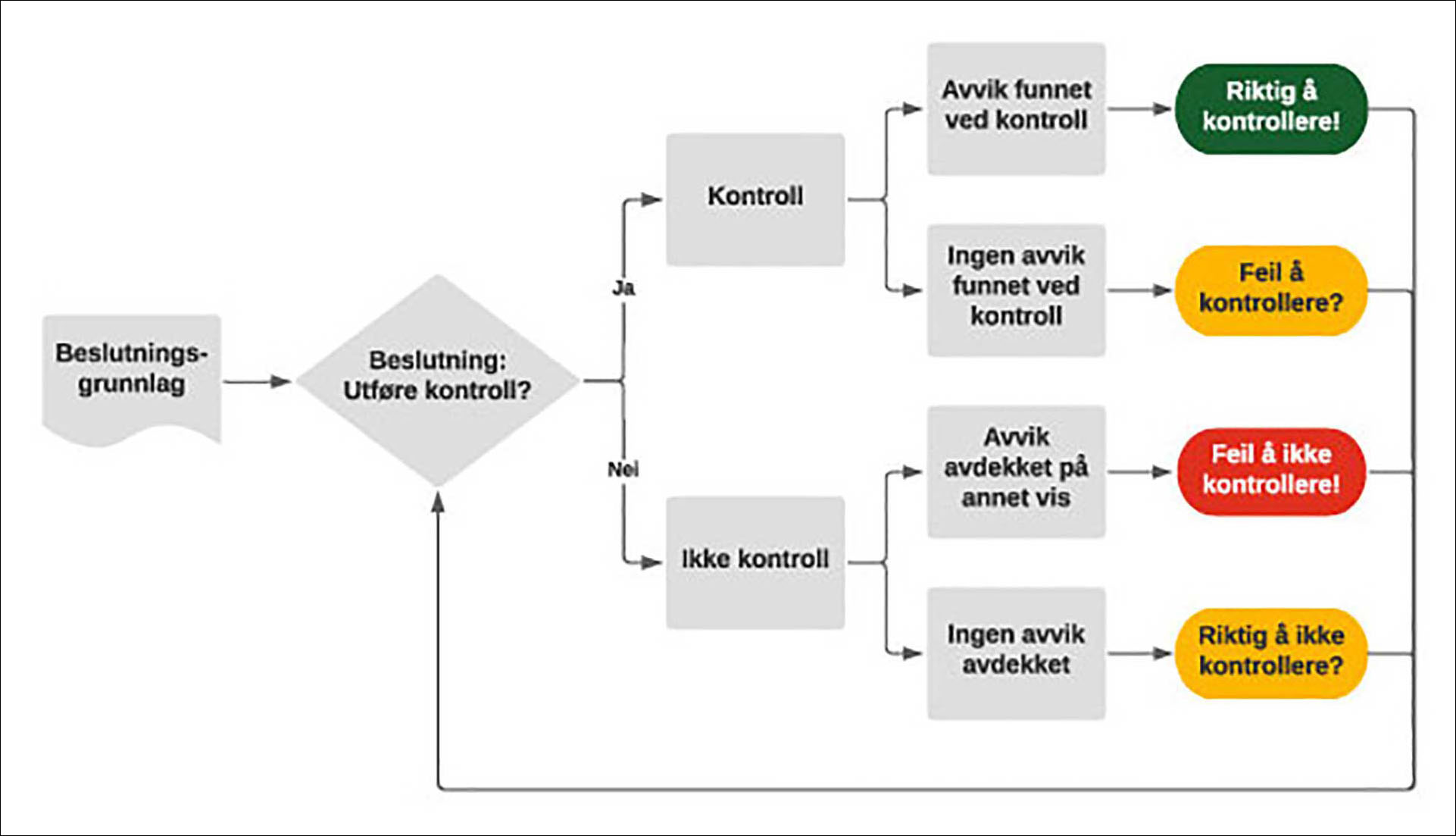

Det meste av dagens kunstige intelligens (AI, fra engelsk «artificial intelligence») bruker såkalt overvåket*På engelsk brukes begrepet «supervised». Det norske begrepet «overvåket» henspiler ikke på personovervåkning – men på at en med denne typen ML-modell styrer/overvåker hva slags vurderinger ML-modellen lærer seg ved å definere ønsket utfall / «fasit» i treningsdataene: F.eks. kan antihvitvasking kunstig intelligens bygges ved å mate overvåkede-ML-algoritmer med data om hvilke historiske transaksjoner som var – og ikke var – knyttet til hvitvasking. ML. Dette er matematiske algoritmer som lar datamaskiner automatisk finne sammenhenger og mønstre i potensielt store datasett, og fra dette bygge komplekse beslutningsmodeller som styrer AI-løsningenes (mer eller mindre) intelligente beslutninger og handlinger: Jo mer relevante data en har om beslutningene som skal tas, jo mer treffsikre og rettferdige ML-modeller kan en bygge. Skal det for eksempel bygges AI for å øke treffsikkerheten av en stikkprøvekontroll, er det viktig med data om hva slags mønstre som tidligere har kjennetegnet saker der kontroll gav funn, se figur 1.

Figur 1: Maskinlærte beslutningsmodeller bygges («trenes») ofte med historiske data om hvordan tilsvarende beslutninger har blitt gjort tidligere, og hva utfallet ble. Fra «Automatisering av revisjon», Revisjon og Regnskap nr. 3 2022.

GDPR og regulatorisk sandkasse

Å bygge verdiskapende kunstig intelligens innenfor rammene av hva GDPR tillater kan være krevende. Mangelen på gode løsninger svekker muligheten til å jobbe datadrevet i europeisk nærings- og samfunnsliv, og på sikt kan det gjøre oss mindre konkurransedyktige sammenlignet med andre jurisdiksjoner, hvor individets rett til privatliv ikke vektes like tungt som kollektivets nytte fra utvikling og bruk av datadrevne løsninger. For å stimulere til ansvarlig innovasjon med kunstig intelligens har Datatilsynet opprettet en regulatorisk sandkasse,*https://www.datatilsynet.no/regelverk-og-verktoy/sandkasse-for-kunstig-intelligens/ der enkeltaktører kan få hjelp til å følge regelverket og utvikle personvernvennlig AI.